Tkzv “nonsense generatorji” so stari skoraj toliko, kot računalniško programiranje, pol stoletja vsaj. Ko zadevo “naučiš” s pomočjo tekstov iz nekega določenega področja, začne generirati tekste, ki se na prvi pogled zdijo pristni. Par znanih primerov:

-

- SCIgen (2005). Generator člankov s področja računalniške znanosti. Domača stran je še dostopna, ampak člankov ne generira več. Tole je članek, ki so ga sprejeli na neko strokovno konferenco, objavili v reviji, ali nekaj takega. Ga ni bilo lahko izbrskati.

- Postmodernistični generator (1996). Stvar še vedno funkcionira in generira nekakšne družboslovne tekste.

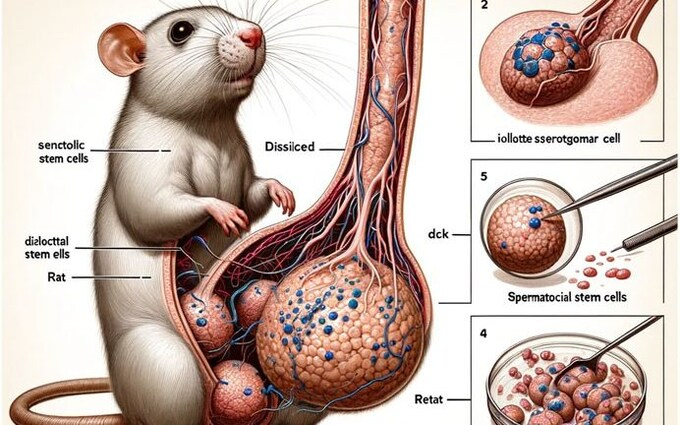

Nič čudnega torej ni, da je nek šaljivec podvalil neki strokovni celularno biološki reviji članek, ki ga je generirala umetna inteligenca. O tem je najprej poročal Telegraph, v plačljivem članku. Paul Joseph Watson ga je dovolj dobro povzel. Kar se mene tiče, slika pove več kot 1000 besed:

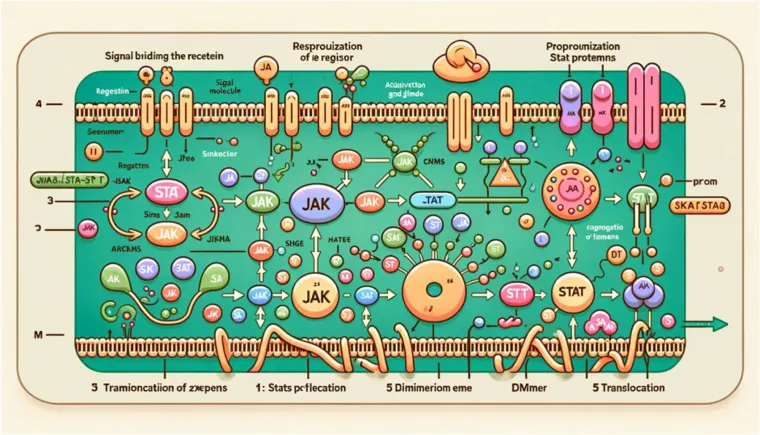

Napisi na sliki nimajo nobenega pomena. Še par naključno generiranih slik, ki prav tako nimajo nobenega pomena:

Če strokovna javnost stalno pada na parodije, kako ne bo padala na resnične ponaredke? Kakorkoli, Bingov ChatGPT je odločno ukrepal: Onemogočil je generiranje slik podgan. Vse, kar lahko dobiš, je ASCII Art in fotorealistična slika podgane, ki v prednjih tacah drži kos sira. Neuporabno za kakršnokoli parodijo ali mem.

Sabine Hossenfelder ima tudi nekaj za povedat na to temo. S povedanim se ne strinjam v celoti, punca je glede politično relevantnih tem popolnoma na korporacijski liniji, ampak vseeno pošiljam v vednost: